La convergence de la créativité humaine et de la créativité machine grâce à l’intelligence artificielle (IA) offre des possibilités fascinantes aux entreprises. Les systèmes d’IA ont la capacité unique d’améliorer la productivité et l’efficacité grâce à l’analyse de données et à la génération de solutions. Toutefois, lorsque les possibilités sont infinies, des considérations juridiques s’ensuivent inévitablement.

Le contexte

L’Union européenne (UE) s’est montrée proactive dans la prise en compte des considérations liées à l’IA en mettant en œuvre la première loi européenne sur l’intelligence artificielle (Loi sur l’IA). Cette loi est l’une des premières à réglementer l’IA et établit un précédent à l’échelle mondiale en matière de gouvernance responsable de l’IA, en plus d’inciter plusieurs experts et organisations à réclamer la mise en place de mesures similaires au sein de leurs administrations respectives. En réponse à des demandes similaires de réglementation de l’IA, le Canada a présenté la Loi sur l’intelligence artificielle et les données (LIAD) dans le cadre du projet de loi C-27. Cependant, ce projet de loi est encore à l’étape de proposition et n’a pas encore été adopté. Et compte tenu de l’ordre parlementaire actuel, il y a de fortes chances qu’il ne le soit jamais. Le projet de loi doit donc être considéré comme une déclaration d’intention, qui pourrait changer s’il n’est pas adopté ou s’il est présenté à nouveau lors d’une session parlementaire ultérieure.

Les dispositions de la LIAD diffèrent de celles de la Loi sur l’IA, mais toutes deux ont pour objectif de promouvoir l’utilisation responsable et sécuritaire des systèmes d’IA. Toutes deux sont par ailleurs confrontées à un même défi : les technologies évoluent plus rapidement que l’adoption de cadres réglementaires. Par exemple, la montée de l’IA générative soulève un large éventail de questions juridiques inédites, en particulier en ce qui a trait à la protection de la vie privée. Même les tribunaux sont confrontés à des questions sans précédent alors qu’ils tentent de suivre l’évolution des technologies.

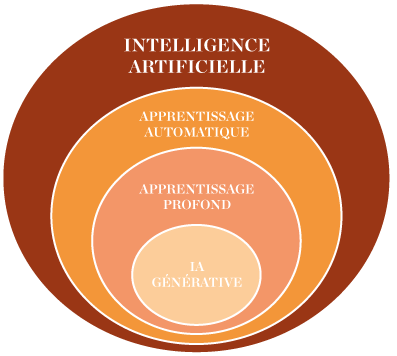

DIAGRAMME A – L’INTELLIGENCE ARTIFICIELLE EN BREF

| INTELLIGENCE ARTIFICIELLE GÉNÉRATIVE |

| Forme d’IA qui utilise des techniques d’apprentissage automatique pour générer du nouveau contenu à partir de ce que le modèle a appris des données à partir desquelles il a été entraîné. |

|

Comparaison des mesures prises par l’UE et le Canada en matière d’IA

La Loi sur l’IA de l’UE, adoptée le 21 mai 2024, prévoit une approche de la réglementation de l’IA fondée sur le risque. Cela implique d’évaluer chaque système d’IA et de le classer en fonction du niveau de risque qu’il présente, de sorte que les différentes applications d’IA doivent respecter des exigences de conformité variables selon les menaces qu’elles présentent pour la société. Par exemple, les systèmes considérés « à haut risque » [1] sont assujettis à une réglementation rigoureuse, qui prévoit notamment de fournir une documentation technique détaillée, de garantir la transparence des données d’entraînement et de soumettre certaines applications à une évaluation de conformité obligatoire réalisée par des tiers. À l’inverse, les systèmes d’IA qui sont réputés présenter un « risque faible ou nul » [2] font l’objet d’un examen nettement moins approfondi, mais ils doivent tout de même respecter le principe fondamental de la transparence [3].

Les règlements pris en vertu de la LIAD suivent une approche distincte de celle de la Loi sur l’IA. Le cadre peut sembler moins précis, mais il a tout de même pour objectif de promouvoir une conception, un développement et une utilisation responsables de l’IA. Les quatre types de systèmes suivants sont assujettis aux règlements pris en vertu de la LIAD :

DIAGRAMME B – SYSTÈMES ASSUJETTIS AUX RÈGLEMENTS PRIS EN VERTU DE LA LIAD

|

SYSTÈME D’INTELLIGENCE ARTIFICIELLE Système technologique qui, au moyen de modèles, procède par inférence pour générer des résultats, notamment des prédictions, des recommandations ou des décisions. |

MODÈLE D’APPRENTISSAGE AUTOMATIQUE Représentation numérique des régularités décelées dans des données au moyen du traitement automatique de celles-ci par un algorithme conçu pour en permettre la reconnaissance ou la reproduction. |

|

SYSTÈME À USAGE GÉNÉRAL Système d’IA conçu pour être adapté en vue d’être utilisé dans divers domaines et à des fins et pour des activités diverses, notamment des domaines, des fins et des activités n’ayant pas été envisagés pendant son développement. |

SYSTÈME À INCIDENCE ÉLEVÉE Système d’IA dont au moins une des utilisations prévues peut raisonnablement être considérée comme faisant partie d’une catégorie d’utilisations définies à l’annexe. |

La LIAD adopte également une approche fondée sur le risque pour atténuer certains préjudices associés aux systèmes d’IA. Ces préjudices comprennent : a) les préjudices physiques ou psychologiques subis par un individu, b) les dommages à ses biens et c) les pertes économiques. Le développement de cette liste dépend de l’évolution de l’IA.

Malgré leurs différences importantes, la Loi sur l’IA et la LIAD servent d’exemples pour d’autres pays qui envisagent de réglementer l’IA. Ces lois doivent toutefois évoluer continuellement pour répondre efficacement aux nouveaux défis juridiques.

Développements récents en matière d’IA

L’IA générative a fait progresser le domaine grâce à sa capacité à générer du texte, des images, de la musique et des vidéos de façon autonome. Or, les considérations juridiques entourant ces technologies demeurent en suspens. Même l’UE et le Canada, pourtant leaders en matière de gouvernance de l’IA, peinent à fournir des réponses définitives.

La Commission européenne a initialement proposé sa réglementation sur l’IA en avril 2021; l’IA générative n’était pas au centre des préoccupations à ce moment-là. Depuis, le monde des technologies a énormément évolué et l’UE a réagi en définissant une nouvelle approche en matière de réglementation de l’IA. L’IA générative est maintenant réglementée en vertu de la Loi sur l’IA [4], et des obligations particulières s’appliquent aux fournisseurs de systèmes d’IA générative. Plus précisément, les fournisseurs doivent mettre en œuvre des mesures de protection avancées pour empêcher la production de contenus qui enfreignent les lois de l’UE, documenter et divulguer l’utilisation de données d’entraînement protégées par le droit d’auteur et satisfaire à des exigences strictes en matière de transparence. Ces mesures visent principalement à protéger les droits de propriété intellectuelle et à prévenir la création et la distribution de contenu trompeur. De plus, les systèmes d’IA générative doivent respecter non seulement les règlements sur l’IA, mais aussi le Règlement général sur la protection des données (RGPD) [5]. Cette double couche de contrôle signifie que les fournisseurs doivent toujours respecter les normes générales en matière de protection de la vie privée tout en repoussant les limites de l’innovation.

Les mesures réglementaires prises par le Canada en réponse à l’essor de l’IA générative sont moins strictes que celles prises par l’UE. Plutôt que de définir explicitement l’IA générative, elle l’inclut implicitement dans une définition plus large de l’IA. Cette définition large soumet vraisemblablement l’IA générative aux mêmes exigences réglementaires que les autres systèmes d’IA [6].

DIAGRAMME C – DÉFINITION GÉNÉRALE DE « SYSTÈME D’IA » DANS LA LIAD

|

SYSTÈME D’INTELLIGENCE ARTIFICIELLE « [...] réseaux neuronaux, apprentissage machine ou autres techniques pour générer du contenu, faire des prédictions ou des recommandations, ou [...] » |

Le gouvernement fédéral a également témoigné de son engagement à aider les organisations à utiliser l’IA en toute sécurité au moyen de son code de pratique [7]. Ce code vise à promouvoir le déploiement sécuritaire des systèmes d’IA et met l’accent sur six éléments fondamentaux : la sécurité; la justice et l’équité; la transparence; la supervision et la surveillance par les humains; la validité et la robustesse; et la responsabilité. Il encourage également les parties prenantes à discuter du sujet, tout en reconnaissant qu’il s’agit de questions nouvelles dont il faut tenir compte, ensemble.

IA générative et nouvelles préoccupations concernant la protection de la vie privée

Cette discussion suggère que la Loi sur l’IA et la LIAD, malgré leurs différences, comportent des étapes progressives dans la réglementation de l’IA. Toutefois, ni le cadre législatif de l’UE ni celui du Canada ne sont axés sur la seule protection de la vie privée. Au contraire, chacun d’entre eux prend en compte le large éventail de conséquences que ces systèmes peuvent avoir sur les droits et libertés des individus, y compris le droit à la vie privée. Ce qui soulève les questions suivantes : Comment les notions de protection de la vie privée recoupent-elles l’IA? Est-il toujours pertinent de discuter de la collecte de données? De l’utilisation de l’IA aux données de sortie, est-ce que c’est de la communication?

Les réponses à ces questions commencent à se préciser au Canada. Le gouvernement fédéral a récemment publié un document [8] sur l’utilisation de l’IA générative, mettant l’accent sur des pratiques responsables et éthiques. Ces principes s’appliquent aux grands modèles de langage (LLM) et aux autres formes d’IA générative. Ce document est précieux pour les organisations qui ont l’intention de mettre en place des pratiques en matière d’IA, mais il n’a pas la même portée que la législation officielle.

Cela dit, le 26 septembre 2023, le Comité permanent de l’industrie et de la technologie (INDU) a entamé un examen détaillé du projet de loi C-27 [9]. Le comité a écouté attentivement les commentaires de divers experts et parties prenantes afin d’orienter les modifications potentielles de la législation. Une grande partie du débat a porté sur les éventuels effets négatifs de l’intelligence artificielle. Le processus d’examen est actuellement en pause, mais devrait reprendre en septembre 2024. Le 19 octobre 2023, Philippe Dufresne, commissaire à la protection de la vie privée, a fait une déclaration digne de mention. Il a préconisé l’obligation d’effectuer des évaluations des facteurs relatifs à la vie privée (EFVP) pour les activités à risque élevé, comme celles qui impliquent l’IA. Il a également souligné que les menaces à la vie privée figurent parmi les trois principaux risques reconnus par les membres du G7 dans un rapport de l’OCDE portant sur l’IA générative.

Le dialogue en cours permettra-t-il de clarifier certaines des questions relatives à l’IA générative et aux préoccupations en matière de protection de la vie privée?

La « loi du cheval » : agir maintenant

Ces questions soulignent la nécessité de trouver des solutions pragmatiques dans les cadres réglementaires existants à ce stade-ci. Cette position s’inspire de l’expression « loi du cheval » tirée d’une conférence donnée en 1996 par le juge Frank H. Easterbrook : « Cyberspace and the Law of the Horse » (Le cyberespace et la loi du cheval). Le juge Easterbrook l’a utilisée pour critiquer la création de domaines juridiques surspécialisés, préconisant plutôt l’application de principes juridiques généraux à de nouveaux domaines du droit. Dans le contexte de l’IA générative, cela implique de tirer parti des principes des normes juridiques établies et de les adapter au contexte unique de ces systèmes. Cette approche permettrait d’éviter les lacunes dans la réglementation, en particulier au fur et à mesure que les technologies continuent de progresser, et inciterait les décideurs politiques à agir dans le cadre des limites qui nous sont familières.

La récente décision de la Commission d’accès à l’information (CAI) va dans ce sens. Le 9 novembre 2022, la CAI a conclu une enquête concernant un outil d’IA conçu pour prédire le risque de décrochage scolaire, en analysant une variété de données d’étudiants dépersonnalisées [10]. L’outil a d’abord été décrit comme un simple mécanisme de recherche de données, mais la CAI a reconnu que celui-ci générait des informations complexes dont l’interprétation nécessiterait généralement une grande expertise humaine en matière de statistiques. La CAI a qualifié les résultats obtenus par ce système d’IA de renseignements personnels, étendant ainsi la portée de la législation sur la protection de la vie privée aux capacités de génération de l’outil.

La perspective selon laquelle les indicateurs basés sur l’IA représentent une « nouvelle collecte et une nouvelle utilisation » des renseignements personnels a suscité une réévaluation de la relation entre les systèmes d’IA et la législation sur la protection de la vie privée au Canada [11]. Elle a précisé que les systèmes d’IA sont effectivement soumis aux lois québécoises sur la protection de la vie privée, bien que l’avenir de la réglementation de l’IA au Canada reste incertain.

Le rôle de Fasken

Si vous envisagez d’intégrer l’IA dans votre entreprise, ne vous laissez pas décourager par ces incertitudes. Notre équipe s’engage à maintenir une position de leader en matière de réglementation de l’IA en adoptant des stratégies pour répondre à toutes les considérations juridiques émergentes. Nous vous tiendrons au courant des derniers développements sur ce sujet.

[1] Les systèmes à haut risque sont ceux utilisés dans les domaines suivants : données biométriques; infrastructures critiques; éducation et formation professionnelle; emploi et gestion des travailleurs; accès aux services privés et publics essentiels; services répressifs; gestion des migrations, de l’asile et des contrôles aux frontières; ou administration de la justice et processus démocratiques (article 6(2) de la Loi sur l’IA).

[2] Les systèmes à risque faible ou nul comprennent des applications comme les filtres de pourriels ou les jeux vidéo tirant partir de l’IA. À moins d’être considérés comme « à risque élevé », la plupart des systèmes d’IA entrent dans cette catégorie.

[3] Commission européenne. Proposition de Règlement du Parlement européen et du Conseil établissant des règles harmonisées concernant l’intelligence artificielle (législation sur l’intelligence artificielle) et modifiant certains actes législatifs de l’Union, 2021.

[4] L’article 6(2) de la Loi sur l’IA définit l’IA générative comme un système « destiné spécifiquement à générer, avec différents niveaux d’autonomie, des contenus tels que des textes, des images, des contenus audio ou des vidéos complexes ».

[5] Union européenne. Règlement général sur la protection des données (RGPD), 2018.

[6] Gouvernement du Canada. Loi sur l’intelligence artificielle et les données : un aperçu, 2022.

[7] Innovation, Sciences et Développement économique Canada, Consultation sur l’élaboration d’un code de pratique canadien pour les systèmes d’intelligence artificielle générative, 2023.

[8] Principes pour des technologies de l’intelligence artificielle générative responsables, dignes de confiance et respectueuses de la vie privée, 2023.

[9] Loi de 2022 sur la mise en œuvre de la Charte du numérique, 2022. https://www.parl.ca/legisinfo/fr/projet-de-loi/44-1/c-27

[10] Commission d’accès à l’information du Québec, Enquête concernant le Centre de services scolaires du Val-des-Cerfs, 2022

[11] Ibid.